Por Cristian Augusto Gonzalez Arias, Universidade de Santiago de Compostela

El antropomorfismo es la tendencia a atribuir características humanas a entidades no humanas, como máquinas o animales. En el caso de los chatbots, como ChatGPT, Gemini o Copilot, este fenómeno ocurre cuando imitan el lenguaje humano para comunicarse con nosotros. No solo utilizan palabras y frases comprensibles y familiares, sino que también adoptan patrones de comunicación propios de las personas. Así, logran mantener conversaciones contextuales y coherentes e, incluso, pueden mostrar humor y empatía.

Este diseño del lenguaje en las máquinas busca que la interacción con ellas sea natural, fluida y accesible. Eso facilita su uso en distintas aplicaciones, desde el servicio al cliente hasta la educación y el entretenimiento.

Hasta ahora, se consideraba que el lenguaje era una capacidad exclusiva del ser humano. Sin embargo, los avances en la inteligencia artificial generativa nos llevan a reconsiderar esta idea.

Uno de los rasgos más distintivos del lenguaje humano es la subjetividad, que se manifiesta en la elección de palabras con carga emocional y en la expresión de opiniones personales. También aparece en la evaluación de eventos y en el uso de elementos contextuales y culturales.

El impacto de la primera persona

Cuando una máquina simula ser humana en la comunicación, surgen implicaciones éticas y psicológicas importantes. Estas interacciones pueden influir en cómo percibimos y nos relacionamos con la tecnología.

Un rasgo típico de la subjetividad humana en el lenguaje es el uso de pronombres personales. La primera persona (como “yo” y “nosotros”) permite expresar pensamientos y experiencias propias. La segunda persona (como “tú” y “vosotros”) involucra al interlocutor, construyendo una relación entre los participantes de la conversación. En la interacción humana, esto se llama intersubjetividad.

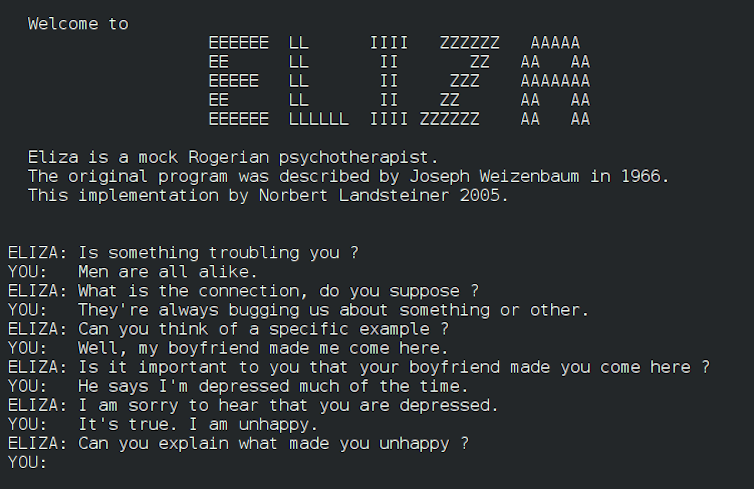

Consideremos un ejemplo.

-

Usuario: “¿Cómo priorizar qué artículos conservar, donar o tirar durante el proceso de organización?”

-

Chatbot: “¡Excelente pregunta! Organizar tus pertenencias puede ser abrumador, pero con una estrategia clara, puedes tomar decisiones más fáciles. Aquí te presento algunas ideas para priorizar qué conservar, donar o tirar”.

El chatbot usa la primera persona de manera implícita. Aunque el “yo” no aparece, el emisor adopta una posición de asesor o guía. Por ejemplo, en la frase “Aquí te presento algunas ideas,” el verbo “presento” está en primera persona.

Esto sugiere que el chatbot asume el rol de quien brinda ayuda. Así, el usuario percibe un trato personal, aunque el “yo” no se emplee de manera explícita. Además, el uso de “presento” refuerza la imagen del emisor como alguien que ofrece algo valioso.

Uso de la segunda persona

El “tú” (y formas como “te” y “tus”) se usa para dirigirse directamente al usuario. Esto se ve en varias partes del texto, como en las frases: “Organizar tus pertenencias puede ser abrumador” y “con una estrategia clara, puedes tomar decisiones más fáciles”.

Al hablarle de forma personal, el chatbot busca que el lector se sienta parte activa del consejo. Este tipo de lenguaje es común en textos que buscan involucrar directamente al otro.

Otros elementos en la interacción, como “¡Excelente pregunta!”, no solo evalúan positivamente la consulta del usuario, sino que también incentivan su participación. Del mismo modo, expresiones como “puede ser abrumador” sugieren una experiencia compartida, creando una ilusión de empatía al reconocer las posibles emociones del usuario.

Efectos de la empatía artificial

El uso de la primera persona por parte del chatbot simula consciencia y busca crear una ilusión de empatía. Al adoptar una posición de ayudante y usar la segunda persona, involucra al usuario y refuerza la percepción de cercanía. Esta combinación genera una conversación que se siente más humana y práctica, adecuada para el asesoramiento, aunque la empatía provenga de un algoritmo, no de una comprensión real.

Acostumbrarnos a interactuar con entidades no conscientes que simulan identidad y personalidad puede tener efectos a largo plazo. Estas interacciones pueden influir en aspectos de nuestra vida personal, social y cultural.

A medida que estas tecnologías mejoran, distinguir entre una conversación con una persona y una con una inteligencia artificial podría volverse difícil.

Este desdibujamiento de los límites entre lo humano y lo artificial afecta cómo entendemos la autenticidad, la empatía y la presencia consciente en la comunicación. Incluso podríamos llegar a tratar a las inteligencias artificiales como si fueran seres conscientes, generando confusión sobre sus capacidades reales.

Incómodos hablando con humanos

Las interacciones con máquinas también pueden modificar nuestras expectativas sobre las relaciones humanas. Al habituarnos a interacciones rápidas, perfectas y sin conflicto, podríamos sentirnos más frustrados en nuestras relaciones con personas.

Las relaciones humanas están marcadas por emociones, malentendidos y complejidad. Esto, a largo plazo, podría disminuir nuestra paciencia y capacidad para manejar los conflictos y aceptar las imperfecciones naturales en las interacciones interpersonales.

Además, la exposición prolongada a entidades que simulan humanidad plantea dilemas éticos y filosóficos. Al atribuirles cualidades humanas, como la capacidad de sentir o tener intenciones, podríamos comenzar a cuestionar el valor de la vida consciente frente a una simulación perfecta. Esto podría abrir debates sobre los derechos de los robots y el valor de la conciencia humana.

Interactuar con entidades no conscientes que imitan la identidad humana puede alterar nuestra percepción de la comunicación, las relaciones y la identidad. Aunque estas tecnologías ofrecen ventajas en términos de eficiencia, es fundamental ser conscientes de sus límites y de los posibles impactos en la forma en que nos relacionamos, tanto con las máquinas como entre nosotros.![]()

Cristian Augusto Gonzalez Arias, Investigador, Universidade de Santiago de Compostela

Este artículo fue publicado originalmente en The Conversation. Lea el original.